En mayo de 2026, la Inteligencia Artificial generativa ha dejado de ser una novedad para convertirse en la columna vertebral de la productividad empresarial. Sin embargo, a medida que modelos como Gemini 3 y otros LLM (Large Language Models) se vuelven más potentes, también ha crecido un fenómeno que quita el sueño a los departamentos jurídicos: las alucinaciones legales.

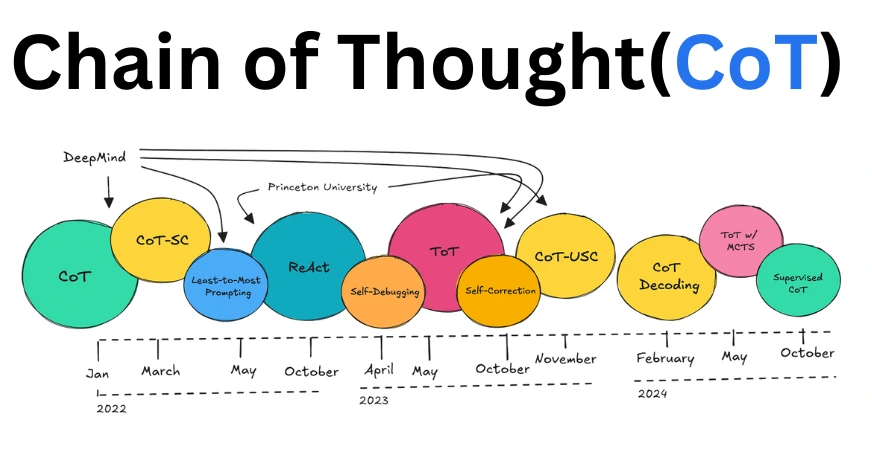

Una alucinación legal no es solo un error factual; es la generación de normativas inexistentes, la cita de jurisprudencia inventada o, peor aún, la creación de contratos con cláusulas que violan leyes vigentes sin que el usuario lo perciba. Para combatir esto, ha surgido una técnica de ingeniería de prompts de élite: el Chain of Thought (CoT) Avanzado.

A continuación, desglosamos cómo utilizar el «razonamiento en cadena» para convertir a la IA en un analista riguroso que minimiza riesgos y garantiza la seguridad jurídica.

¿Qué es el Chain of Thought (CoT) y por qué es vital en leyes?

El Chain of Thought es una técnica que obliga al modelo de IA a descomponer un problema complejo en pasos lógicos intermedios antes de ofrecer una respuesta final. En lugar de pasar directamente del «Prompt» al «Resultado», forzamos a la IA a mostrar su «proceso de pensamiento».

En el ámbito legal, esto es revolucionario. La ley no es solo un conjunto de datos, sino un sistema de lógica aplicada. Cuando permitimos que una IA responda de forma instantánea a una consulta jurídica compleja, aumentamos el riesgo de que el modelo use «atajos probabilísticos» (predecir la palabra siguiente más probable) en lugar de aplicar una deducción lógica. El CoT rompe este patrón, obligando al modelo a validar cada premisa antes de pasar a la siguiente.

La Anatomía de una Alucinación Legal

Para entender cómo el CoT nos protege, primero debemos saber contra qué luchamos. Las alucinaciones legales suelen ocurrir por tres razones:

- Mezcla de Jurisdicciones: La IA confunde leyes de España con las de México o leyes federales de EE. UU. con estatales.

- Leyes Derogadas: El modelo utiliza información de su entrenamiento que ya no está vigente en 2026.

- Falsa Autoridad: La IA inventa el número de un artículo o una sentencia para satisfacer la estructura gramatical del prompt.

El CoT actúa como un auditor interno que detecta estas inconsistencias antes de que lleguen al documento final.

Implementando CoT Avanzado: El Marco de los 4 Pasos

Para obligar a la IA a razonar legalmente, no basta con decir «piensa paso a paso». Necesitas una estructura de Prompting de Razonamiento Estructurado. Aquí te presentamos el método que están adoptando las grandes firmas de consultoría:

Paso 1: La Fase de Anclaje Normativo

En lugar de pedir una conclusión, ordena a la IA que identifique primero el marco legal aplicable.

- Prompt CoT: «Paso 1: Identifica la ley vigente en [País/Región] que regula [Tema]. Enumera los artículos específicos sin resumirlos aún.»

Paso 2: El Desglose de Premisas

Obliga a la IA a conectar los hechos del caso con la ley identificada.

- Prompt CoT: «Paso 2: Analiza los hechos que te he proporcionado. Para cada hecho, indica qué artículo de la lista anterior se aplica y por qué. Si un hecho no encaja en la norma, decláralo explícitamente.»

Paso 3: La Verificación de Vigencia y Conflictos

Aquí es donde se detienen las alucinaciones.

- Prompt CoT: «Paso 3: Actúa como un revisor crítico. Verifica si alguna de las normas citadas ha sido modificada o derogada según tu base de datos actualizada a 2026. Comprueba si hay contradicciones entre la normativa local y la internacional.»

Paso 4: Síntesis y Conclusión Detallada

Solo tras completar los tres pasos anteriores, la IA genera el dictamen o contrato.

Ejemplo Práctico: Redacción de una Cláusula de Privacidad

Imagina que necesitas una cláusula para una web que usa IA. Un prompt tradicional sería: «Escribe una cláusula de privacidad para mi web». El resultado será genérico y probablemente arriesgado.

Usando CoT Avanzado:

«Quiero que redactes una cláusula de privacidad. Antes de escribirla, sigue esta cadena de pensamiento:

- Analiza los requisitos del RGPD y la Ley de IA de la UE de 2026.

- Identifica qué datos específicos de telemetría recoge mi app (te los daré a continuación).

- Explica paso a paso cómo se cumple el principio de transparencia en cada flujo de datos.

- Solo después de este análisis, redacta la cláusula final.»

Este proceso garantiza que la cláusula no sea un «copia y pega», sino un documento nacido de un razonamiento lógico-legal.

Beneficios para la Monetización y el SEO

Si diriges un portal sobre prompts, el contenido sobre CoT Avanzado es una mina de oro para Google AdSense. ¿Por qué?

- Nicho de Alto Valor: Las empresas están desesperadas por implementar IA de forma segura. El contenido que resuelve problemas de «riesgo y cumplimiento» atrae anuncios de software empresarial caro.

- Autoridad E-E-A-T: Al explicar técnicas de razonamiento lógico, demuestras que tu sitio no solo ofrece «prompts curiosos», sino soluciones técnicas para profesionales.

- Tiempo de Permanencia: Los artículos que incluyen metodologías paso a paso invitan al usuario a leer detenidamente y probar los prompts, lo que aumenta las métricas de retención de tu web.

El «Self-Correction Prompting»: El siguiente nivel del CoT

En 2026, el CoT ha evolucionado hacia el Self-Correction (Autocorrección). Esto implica pedirle a la IA que, una vez terminado el razonamiento, intente «derribar» sus propios argumentos.

Instrucción Adicional: «Ahora que has terminado el análisis, actúa como un abogado de la parte contraria y busca tres debilidades legales en tu propio razonamiento. Luego, ajusta tu conclusión inicial para fortalecer esas debilidades.»

Este nivel de rigor es lo que separa a un aficionado de un experto en Prompt Engineering. Al forzar a la IA a ser su propio adversario, las posibilidades de una alucinación legal se reducen a niveles cercanos al cero absoluto.

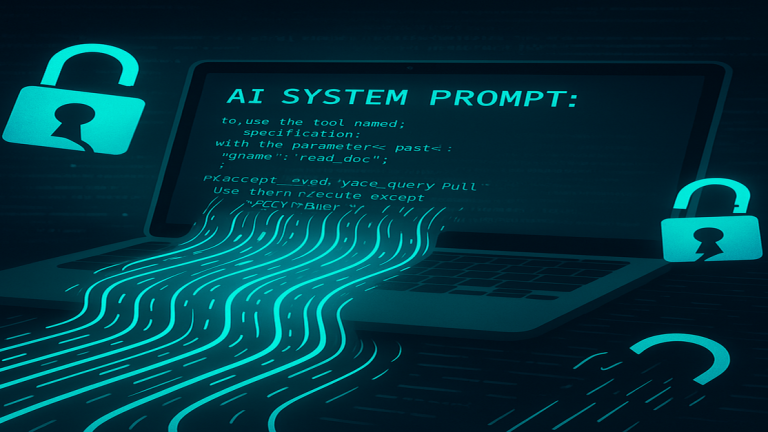

El Rol de los «System Prompts» en la Prevención de Alucinaciones

Para los dueños de negocios que utilizan APIs de IA, el CoT debe estar integrado en el System Prompt (la instrucción base del sistema). Configurar tu IA con una instrucción persistente como: «Siempre que se te consulte sobre temas legales, debes desglosar tu razonamiento en premisas, citas verificadas y conclusiones lógicas» asegura que todos los empleados de la empresa operen bajo el mismo estándar de seguridad.

Conclusión: Hacia una IA Responsable y Lógica

La técnica de Chain of Thought no es solo un truco para que la IA parezca más inteligente; es una necesidad ética y legal en 2026. A medida que delegamos tareas más críticas en la Inteligencia Artificial, nuestra responsabilidad como «promptadores» es asegurar que el camino hacia la respuesta sea tan sólido como la respuesta misma.

Evitar las alucinaciones legales no se logra con mejores modelos, sino con mejores instrucciones. Al obligar a la IA a pensar paso a paso, estamos protegiendo nuestras empresas, nuestra reputación y el futuro de la colaboración humano-máquina.

Muy importante tener todo esto al dia

La gente debe de informarse mas sobre todas estas cosas.