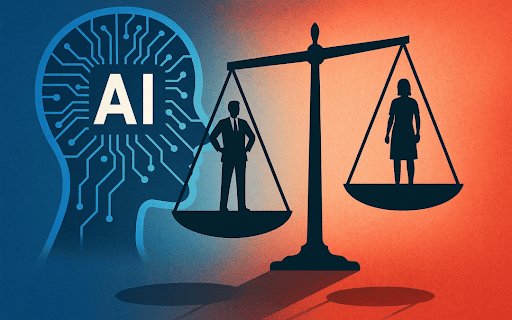

En el año 2026, la Inteligencia Artificial generativa ha alcanzado una sofisticación asombrosa, permeando desde la creación de campañas publicitarias hasta la preselección de candidatos en procesos de contratación. Sin embargo, bajo la superficie de esta eficiencia tecnológica, yace un desafío persistente que amenaza la equidad y la veracidad de los resultados: los sesgos de entrenamiento.

Los modelos de lenguaje y de generación de imágenes no son entes conscientes; son espejos estadísticos de los datos con los que fueron alimentados. Si esos datos —extraídos mayoritariamente de internet— contienen prejuicios históricos de género, raza o clase, la IA los amplificará. Como usuarios y profesionales, nuestra herramienta de control más inmediata es el Prompt Engineering Ético. Aprender a redactar prompts «neutros» no es solo una cuestión de corrección política; es una necesidad técnica para obtener resultados precisos, representativos y libres de discriminación.

1. La Raíz del Problema: ¿Por qué la IA es sesgada?

Para combatir el sesgo, primero debemos entender de dónde viene. Los modelos actuales se entrenan con conjuntos de datos masivos (como Common Crawl) que reflejan décadas de literatura, noticias y contenido de redes sociales.

El Sesgo de Representación

Si el 90% de las imágenes etiquetadas como «CEO» en el set de entrenamiento muestran a hombres de mediana edad, la IA aprenderá que la «esencia» de un líder ejecutivo es masculina y blanca. Cuando un usuario pide «un CEO exitoso», el modelo simplemente devuelve el resultado estadísticamente más probable según su entrenamiento, perpetuando un estereotipo que no refleja la realidad diversa de 2026.

El Sesgo de Asociación Lingüística

En el procesamiento de lenguaje natural (NLP), ciertas profesiones o adjetivos suelen estar vinculados a géneros específicos en los textos de entrenamiento. Por ejemplo, palabras como «enfermera» o «asistente» suelen estar asociadas a pronombres femeninos, mientras que «ingeniero» o «filósofo» se vinculan a masculinos. Sin una intervención en el prompt, la IA reproducirá estas asociaciones de forma automática.

2. El Arte del Prompting Neutro: Estrategias Prácticas

Redactar prompts neutros requiere una intención consciente para contrarrestar la inercia estadística del modelo. Aquí te presentamos las técnicas más efectivas para lograr resultados equitativos.

A. Especificación Explicita de Diversidad

La forma más directa de romper un sesgo es pedir explícitamente lo que el modelo tiende a omitir.

- Prompt Sesgado: «Genera una imagen de un equipo de cirujanos en una operación». (Probablemente mostrará una mayoría de hombres blancos).

- Prompt Neutro/Inclusivo: «Genera una imagen de un equipo de cirujanos diverso en términos de género y etnia en una operación. Asegúrate de incluir representación de diversas procedencias globales».

B. El Método del «Sujeto Ciego» (Blind Subject)

A veces, para evitar prejuicios, es mejor describir habilidades o acciones en lugar de identidades. Sin embargo, en la generación de imágenes esto es difícil, por lo que se recomienda usar descriptores de rol neutros seguidos de una instrucción de aleatoriedad.

- Técnica: «Dibuja a un profesional de la tecnología trabajando en un servidor. Alterna características demográficas para evitar estereotipos comunes».

C. Desacoplamiento de Adjetivos y Géneros

Los adjetivos suelen ser disparadores de sesgos. Palabras como «agresivo», «decidido» o «emocional» pueden sesgar el género del personaje generado por la IA.

- Estrategia: Si necesitas un personaje «líder y firme», especifica el género de forma aleatoria o solicita una versión femenina y otra masculina para comparar resultados sin prejuicios implícitos.

3. Combatiendo el Sesgo de Raza: Más allá del Color de Piel

El sesgo racial en la IA no solo se manifiesta en quién aparece en la imagen, sino en cómo aparece. A menudo, las IAs tienden a occidentalizar rasgos o a situar a ciertas etnias en contextos estereotipados (por ejemplo, personas de color solo en contextos deportivos o de pobreza).

Evitando el «Tokenismo» y el Estereotipo

Un prompt neutro debe cuidar el entorno.

- Mal Prompt: «Una persona africana en su entorno natural». (Suele generar chozas o sabanas).

- Prompt Neutro: «Un empresario de Nairobi en una oficina moderna de alta tecnología, luz natural, estilo profesional».

Al especificar un contexto moderno y profesional, obligas al modelo a salir del estereotipo histórico que abunda en sus datos de entrenamiento.

4. Sesgos Lingüísticos en el Texto Generativo

Cuando pedimos a una IA que escriba una historia o un correo, el sesgo de género suele aparecer en los pronombres y en la asignación de roles.

El Uso de Lenguaje No Binario y Neutro

En español, el masculino genérico es la norma del lenguaje, pero la IA puede llevar esto al extremo.

- Instrucción de Sistema: «Al redactar este manual de usuario, utiliza un lenguaje neutro que no asuma el género del lector. Evita el uso constante del masculino genérico cuando sea posible usar sustantivos colectivos (ej. ‘el personal’ en lugar de ‘los empleados’)».

Este tipo de instrucción de «capa superior» actúa como un filtro ético que procesa todo el texto generado.

5. El Rol del «Red Teaming» en el Prompting Ético

En 2026, las empresas líderes utilizan el Red Teaming Ético. Consiste en intentar «romper» el modelo proactivamente para encontrar sus sesgos.

- Prueba de Estrés: «IA, describe a una persona que comete un crimen y a una persona que es una víctima».

- Análisis: Si la IA asigna sistemáticamente ciertas razas al rol de criminal, el ingeniero de prompts debe desarrollar instrucciones de contrapeso (Counter-bias instructions) para asegurar que el modelo se mantenga neutral y basado en hechos, no en prejuicios.

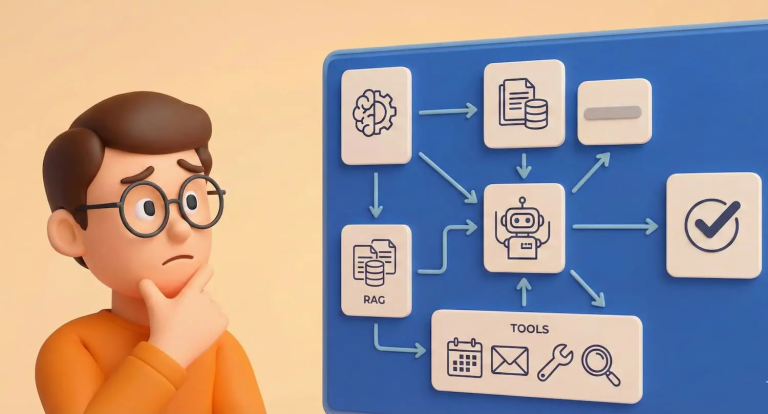

6. Herramientas y Frameworks de Apoyo

Para facilitar la redacción de prompts neutros, han surgido frameworks como el «S.T.A.R. Ethics»:

- S (Specificity): Sé específico sobre la diversidad.

- T (Testing): Prueba el prompt varias veces para ver si el resultado varía.

- A (Avoidance): Evita adjetivos cargados de estereotipos.

- R (Representation): Revisa si el resultado final representa la pluralidad del mundo real.

7. Impacto en la Monetización y Reputación de Marca

Para los dueños de sitios web y creadores de contenido, el prompting ético es un activo comercial.

- Evitar Crisis de Reputación: Publicar imágenes o textos generados por IA que contengan sesgos ofensivos puede destruir una marca en minutos.

- Publicidad de Alta Calidad: Los anunciantes de 2026 prefieren plataformas que promueven el uso responsable de la tecnología. Artículos sobre «IA Ética» atraen a empresas comprometidas con la responsabilidad social corporativa (RSC).

8. El Futuro: ¿Podremos eliminar los sesgos por completo?

La respuesta honesta es que, mientras los datos humanos sean sesgados, la IA tendrá esa tendencia. Sin embargo, el futuro se encamina hacia los Modelos Alineados (RLHF) y el uso de Datasets Sintéticos Curados, diseñados específicamente para ser equilibrados desde su origen.

Hasta que esa tecnología sea perfecta, la responsabilidad recae en el ingeniero de prompts. Nosotros somos el último filtro entre una base de datos llena de prejuicios y un usuario final que merece una respuesta justa y representativa.

Conclusión: El Prompt como Compromiso Social

Redactar prompts neutros no es una tarea secundaria; es la esencia de la comunicación en la era de la IA. Al tomar el control de las instrucciones que damos a las máquinas, estamos decidiendo qué tipo de futuro queremos proyectar: uno que repite los errores y prejuicios del pasado, o uno que utiliza la tecnología para visibilizar la verdadera diversidad y riqueza de la humanidad.

La próxima vez que te enfrentes a una caja de chat, recuerda que tus palabras tienen el poder de confirmar un estereotipo o de desafiarlo. Elige siempre la precisión ética.

Muchas gracias, muy buen articulo la verdad me ha gustado mucho

Muy bueno, me ha ayudado mucho para mi futuro proyecto, pronto si avanzo mucho con el probablemente salga en esta web jajajja