Hasta hace relativamente poco, cuando hablabas con una IA le dabas texto y te devolvía texto. Era útil, pero limitado. El modelo no podía ver una imagen, no podía leer un gráfico, no podía analizar una factura escaneada ni inspeccionar visualmente nada.

Eso cambió. Los modelos multimodales actuales, como GPT-4o o Gemini 1.5 Pro, pueden procesar imágenes, documentos, capturas de pantalla y fragmentos de vídeo junto con instrucciones de texto. Y eso abre un tipo de automatización completamente diferente al que la mayoría de la gente está explorando.

Este artículo va sobre eso: cómo usar prompts que incluyen imágenes o documentos para automatizar tareas del mundo real que antes requerían intervención humana o software especializado muy caro.

Qué significa que la IA «vea» y por qué cambia las reglas

Cuando le envías una imagen a un modelo multimodal junto con un prompt, el modelo procesa ambas cosas simultáneamente. No describe la imagen por separado y luego sigue con el texto. La imagen y las instrucciones se combinan en una sola consulta, y el modelo razona sobre ambas a la vez.

Esto significa que puedes hacer cosas como enviar una foto de un almacén y preguntar qué paquetes no tienen la etiqueta correcta. O mandar una captura de pantalla de un panel de analítica y pedir que identifique las métricas que han caído más de un 15% respecto a la semana anterior. O subir una factura en PDF y extraer automáticamente el IBAN, el importe total y la fecha de vencimiento en formato JSON.

La clave en todos estos casos es que el prompt tiene que ser igual de preciso que cuando trabajas solo con texto, o más. La IA ve la imagen pero no sabe qué es importante para ti a menos que se lo digas explícitamente.

Cómo estructurar un prompt de visión que realmente funcione

El error más común cuando la gente empieza a usar prompts con imágenes es ser demasiado vago. «Analiza esta imagen y dime qué ves» produce una descripción general que raramente sirve para nada práctico.

Lo que funciona es ser muy específico sobre qué buscar y en qué formato quieres la respuesta. Una técnica útil es dividir visualmente la imagen en zonas para el modelo. Por ejemplo: «divide la imagen en una cuadrícula de 3×3. En la zona superior izquierda, identifica si el indicador de presión está en verde, amarillo o rojo. Responde únicamente con el color y la zona.»

Cuanto más acotes el espacio de posibles respuestas, más preciso y útil será el output. Esto es especialmente importante en entornos industriales o profesionales donde un error del modelo tiene consecuencias reales.

Otra técnica que uso mucho es el análisis de diferencias, que consiste en enviar dos imágenes, una del estado correcto y otra del estado actual, y pedirle al modelo que identifique las desviaciones. Es brutalmente eficaz para control de calidad visual, comparación de diseños o verificación de que un proceso se ejecutó correctamente.

Extracción de datos de documentos: facturas, contratos y formularios

Una de las aplicaciones más prácticas e inmediatas del prompting multimodal es la extracción de datos de documentos. Si procesas facturas, contratos, albaranes o cualquier tipo de formulario de forma manual, esto puede ahorrarte horas cada semana.

El truco para que funcione bien es anclar visualmente lo que buscas. En lugar de «extrae el total de esta factura», di: «busca la palabra ‘Total’ o ‘Importe total’ en el documento. Extrae el número que aparece inmediatamente a su derecha o debajo. Devuelve el resultado en formato JSON con los campos: importe, moneda, fecha_emision, numero_factura.»

Añadir una validación cruzada también mejora mucho la fiabilidad. Por ejemplo, pedirle al modelo que después de extraer el IBAN lo busque en otra parte del documento para confirmar que coincide. Esto reduce drásticamente los errores por alucinación, que son el mayor riesgo cuando procesas documentos financieros con IA.

Para documentos con estructura muy variable, como contratos redactados de formas distintas, funciona mejor un enfoque en dos pasos: primero un prompt que identifica qué tipo de documento es y dónde suelen estar los campos clave en ese tipo, y luego un segundo prompt que extrae los datos usando esa información de contexto.

Análisis de vídeo: lo que muy poca gente está usando todavía

El análisis de fragmentos de vídeo es probablemente la aplicación más infrautilizada del prompting multimodal ahora mismo, en parte porque no todo el mundo sabe que es posible y en parte porque requiere un poco más de setup técnico.

La idea básica es enviar fotogramas clave del vídeo junto con instrucciones sobre qué analizar. No envías el vídeo completo, sino los frames que contienen la información relevante. Un modelo pequeño y barato puede encargarse de seleccionar esos frames automáticamente detectando cambios de escena o momentos de actividad.

Una aplicación concreta que tiene mucho valor práctico es el análisis de grabaciones de sesiones de usuario para investigación de UX. En lugar de revisar manualmente horas de grabaciones para encontrar los momentos donde el usuario se confunde o el interfaz falla, puedes enviar los frames al modelo con una instrucción como: «identifica en qué momentos el usuario parece dudar, retrocede o repite una misma acción más de dos veces. Indica el segundo aproximado y describe qué estaba haciendo.»

Lo que hace esto en términos de ahorro de tiempo es significativo. Una sesión de 30 minutos que normalmente requeriría revisar manualmente para extraer insights se procesa en cuestión de minutos.

De la observación a la acción: el paso que multiplica el valor

Hasta ahora hemos hablado de usar la IA para analizar y extraer información. Pero el verdadero salto de valor ocurre cuando conectas ese análisis con una acción automática.

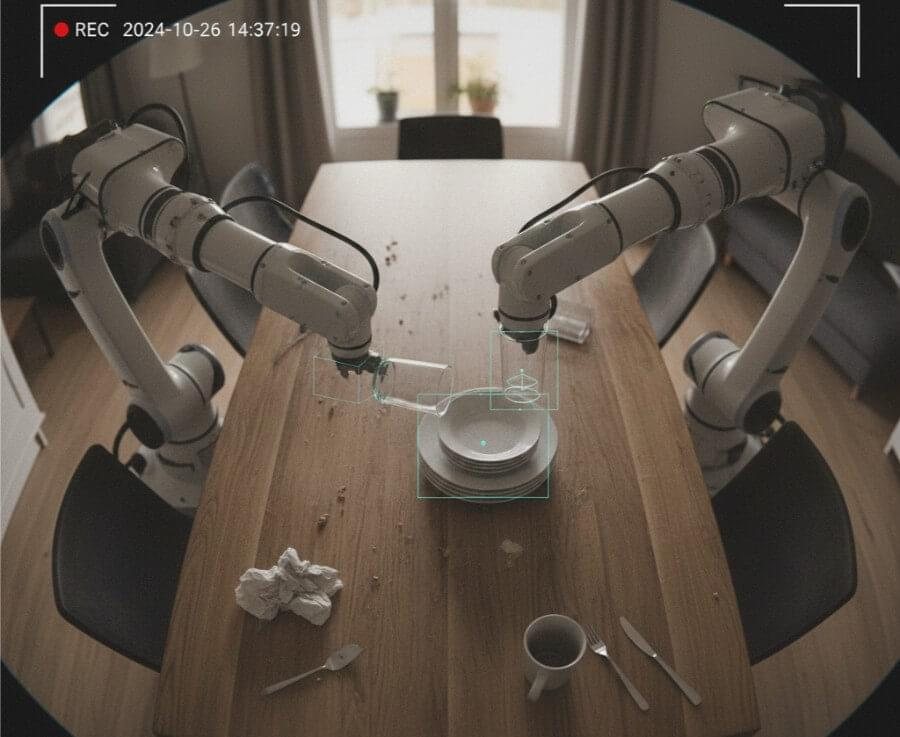

El esquema es siempre el mismo: un agente observa mediante visión, otro razona sobre lo que observó, un tercero decide qué hacer y un cuarto ejecuta la acción. Cada paso es un prompt distinto con un rol claro.

Por ejemplo, en un e-commerce: el agente de visión analiza una foto de producto enviada por un proveedor. El agente de razonamiento comprueba que cumple los requisitos de calidad de imagen, fondo y encuadre. El agente de decisión genera automáticamente la descripción de producto basándose en lo que ve. El agente de acción la formatea y la prepara para subir a la tienda.

Todo ese flujo, desde la foto bruta hasta el contenido listo para publicar, puede correr sin intervención humana para productos estándar. Solo los casos que el agente de calidad rechaza necesitan revisión manual.

Los límites reales que conviene conocer

Para usar esto bien hay que entender también dónde falla. Los modelos multimodales tienen dificultades con imágenes de baja calidad, texto muy pequeño dentro de imágenes, escenas muy saturadas de elementos o situaciones donde la iluminación es muy mala. En esos casos el modelo puede «ver» algo que no está ahí o perderse detalles importantes.

La privacidad es otro factor crítico. Cuando la IA procesa imágenes que contienen caras, datos personales o información sensible, necesitas tener claro qué política de retención de datos tiene el proveedor que estás usando y si eso cumple con la normativa aplicable a tu caso.

Y finalmente, como con cualquier automatización, el coste de procesar imágenes es mayor que el de procesar texto equivalente. Para flujos de alto volumen conviene optimizar: comprimir imágenes antes de enviarlas, usar modelos más pequeños para la clasificación inicial y reservar los modelos más potentes solo para los casos que realmente los necesitan.

Por qué esto importa ahora

La mayoría de las empresas todavía gestionan procesos visuales de forma manual porque el software de visión artificial tradicional era caro, requería entrenamiento específico y no se adaptaba bien a variaciones en los datos.

Los modelos multimodales de lenguaje cambian esa ecuación completamente. No necesitas entrenar nada ni contratar a un especialista en visión artificial. Con un prompt bien construido y un modelo disponible vía API puedes automatizar procesos que antes eran exclusivos de empresas con presupuestos de seis cifras.

Esa es la oportunidad real del prompting multimodal, y todavía hay muy poca competencia en aplicarla bien.